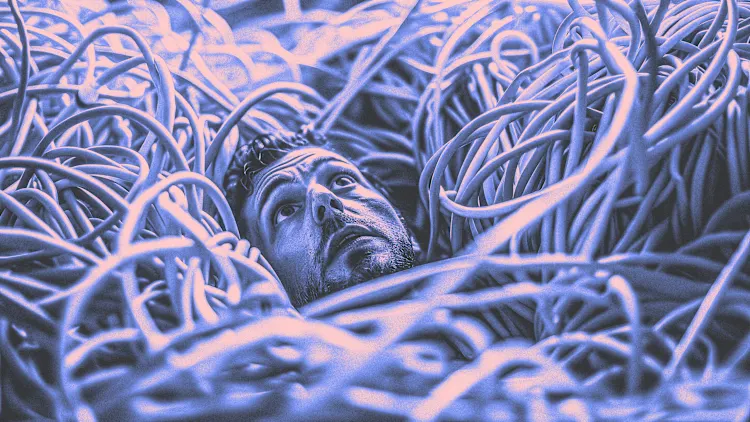

“Esas herramientas de IA se están entrenando con nuestros secretos comerciales. Perderemos a todos nuestros clientes si descubren que nuestros equipos usan IA. Nuestros empleados perderán la capacidad de pensar críticamente debido al deterioro cognitivo causado por la excesiva dependencia de la IA”. Sí, estos temores no están fuera de la realidad. A medida que la IA sigue acaparando los titulares, las preguntas sobre la privacidad y la seguridad de los datos, la propiedad intelectual y la calidad del trabajo son válidas e importantes.

La tentación de responder con un simple “no” es fuerte. Suena fácil y, sobre todo, seguro. Pero esa aparente seguridad es, en realidad, la apuesta más arriesgada. Prohibir por completo el uso de la IA no solo limita el aprendizaje y la innovación: también fomenta una cultura de desconfianza, incrementa los riesgos de seguridad y deja a cualquier organización en una clara desventaja competitiva.

Soy fundador de dos agencias tecnológicas y un firme defensor del uso responsable de la IA. En nuestras operaciones trabajamos con datos sensibles de clientes en sectores como el gobierno, la salud y la educación. Y precisamente por eso, estoy convencido de que existe una forma mucho más inteligente de enfrentar los riesgos que plantea la IA. En este artículo, explico por qué las prohibiciones absolutas no son la solución y qué pueden hacer las empresas en su lugar.

Crisis de curiosidad

Puedes prohibir las herramientas, pero no la curiosidad, sobre todo entre desarrolladores y gerentes de producto, ya que se les paga por ser innovadores. No viven aislados. Pueden tener ideas creativas en mucho menos tiempo y simplemente quieren probarlas.

Además, los empleados pueden sentir que no usar la IA a diario los pone en desventaja en comparación con sus compañeros que trabajan en otras empresas donde se permite la IA.

Prohibir las herramientas de IA no las detiene; solo las empuja a la sombra. Los estudios lo confirman, las restricciones absolutas fomentan su uso clandestino. Una encuesta de Cisco reveló que 60% de los encuestados (incluidos profesionales de seguridad y privacidad de diversos países) introdujeron información sobre procesos internos de la empresa en herramientas de genAI; 46% introdujo nombres o información de empleados y 31%, nombres o información de clientes.

Así nace la llamada “TI en la sombra”: cuando la tecnología se usa sin autorización dentro de una organización. Y ahora, una nueva tendencia se suma al panorama, “Traiga su propia IA“.

Otro estudio de Anagram revela una realidad aún más alarmante: 58 % de los empleados encuestados en Estados Unidos admitió que introdujo datos confidenciales en modelos de lenguaje complejos. Además, 40% estaba dispuesto a infringir deliberadamente las normas de la empresa para completar una tarea con mayor rapidez. Sin duda, lo prohibido es lo más tentador.

En consecuencia, la visibilidad es nula. Desconoces qué herramientas se utilizan, qué datos se introducen y qué riesgos se asumen. La ironía es evidente, el problema que querías controlar ahora está completamente fuera de tu alcance.

Paradoja de seguridad

El principal motivo de la prohibición es proteger los datos confidenciales. Sin embargo, la prohibición aumenta la probabilidad de una filtración, no la reduce.

Los empleados pueden crear cuentas personales y usar planes gratuitos o más económicos, que a menudo utilizan por defecto sus datos para el entrenamiento de modelos. Carecen de funciones de seguridad robustas, registros de auditoría y acuerdos de procesamiento de datos (DPA).

Por el contrario, los planes empresariales, como ChatGPT Business o Enterprise, suelen incluir garantías de que sus datos no se utilizarán con fines de formación. Pueden ofrecer inicio de sesión único (SSO), cifrado de datos, controles de acceso y supervisión administrativa.

Tus datos confidenciales, que temías que se filtraran por un canal oficial, se filtran a través de docenas de cuentas personales imposibles de rastrear. Podrías haberlos protegido con un plan empresarial, pero en lugar de eso, los expusiste a la intemperie.

Conducir por el carril lento

Mientras nosotros debatimos, los competidores ya están actuando. Con solo 19% de los directivos de alto nivel reportando un aumento superior a 5% en los ingresos atribuido a la IA, quizá sea demasiado pronto para hablar del retorno de la inversión. Además, la razón de un retorno de la inversión relativamente bajo podría no residir en la IA en sí, sino en la forma en que la utilizamos. Cada vez más empresas consideran aplicar la IA a las operaciones centrales del negocio en lugar de a los procesos periféricos.

Los casos de uso de la IA en el ámbito empresarial son numerosos. Sé de primera mano que las mejoras en la productividad que aporta la IA son significativas. En Redwerk, no le damos la espalda al desarrollo asistido por IA y enseñamos a nuestros clientes cómo configurar estos flujos de trabajo. No vemos la IA como una amenaza que le quite el trabajo a los desarrolladores; la vemos como una herramienta que nos permite realizar un trabajo más profundo con mayor rapidez.

Un caso de uso práctico para los desarrolladores es la generación de código repetitivo o la documentación de API en segundos, en lugar de horas. Con la IA, nuestros gestores de producto pueden analizar los comentarios de los usuarios a gran escala, generar ideas para nuevas funciones y realizar estudios de mercado mucho más rápido.

En QAwerk, utilizamos una variedad de herramientas de prueba de IA para generar casos de prueba, identificar casos límite poco comunes e incluso realizar escaneos iniciales de vulnerabilidades de seguridad.

Aprendamos a usarla, no depender de ella

No es una moda pasajera y llegó para quedarse. Cada vez más aplicaciones desarrollan funciones de IA para mantenerse a la par de la competencia. La IA seguirá transformando la dinámica laboral. Herramientas de productividad como Slack, Zoom y Asana (todas ellas ahora potenciadas con IA) se integraron en las operaciones diarias de las empresas tecnológicas. Los principales proveedores de servicios en la nube y bases de datos ofrecen ahora IA con agentes para empresas.

Se invierten miles de millones en OpenAI, a pesar de que la empresa opera con pérdidas, porque reconocen que la IA es el futuro. Todos estos hechos indican claramente una cosa: la IA llegó para quedarse.

Cómo adoptarla de forma responsable

A lo largo de mi trayectoria emprendedora, aprendí que ser proactivo es una estrategia más eficaz que ser reactivo. Y esto se aplica a todo, incluida la IA. Cuando preguntas como “¿Utilizas IA?” se hace para apoyar a los empleados en lugar de reprenderlos, vas por buen camino. No hace falta complicar las cosas; simplemente empieza.

Paso 1: guía a tu equipo, no prohíbas

Crea una Política de Uso Aceptable (PUA) sencilla con lo que se puede y no se puede hacer. Por favor, evita PDFs de 40 páginas que nadie va a leer (aparte de quien los creó). Define claramente qué es aceptable y qué no. Por ejemplo, las herramientas de IA están aprobadas para generar ideas, aprender y trabajar con código no confidencial. No introduzcas datos de clientes, información personal identificable ni propiedad intelectual de la empresa en modelos de IA públicos.

Paso 2: Dale herramientas a tu equipo

Invierte en una herramienta de IA segura y de nivel empresarial. El costo es mínimo comparado con el aumento de la productividad y el riesgo de un uso no controlado. Antes de hacerlo, consulta con el equipo para conocer sus preferencias. Probablemente tengan muchas solicitudes que funcionen mejor en Gemini que en Claude o ChatGPT, o viceversa. Debes recopilar todos los casos de uso principales e investigar la herramienta que mejor los satisfaga. Esto proporciona a tu equipo un entorno de pruebas seguro y aprobado para trabajar.

Paso 3: Educa y empodera

¿Sabías que los millennials son incluso más defensores de la IA que la Generación Z? 62 % de los millennials afirmó tener un alto nivel de experiencia en IA. En muchas organizaciones, los millennials ocupan puestos directivos y pueden convertirse en verdaderos impulsores del cambio. Por lo tanto, su entusiasmo debería fomentarse en lugar de reprimirse.

Organiza talleres. Comparte las mejores prácticas para una ingeniería ágil. Crea un canal específico en Slack/Teams para que la gente comparta casos de uso interesantes y descubrimientos. Conviértelo en una exploración colaborativa y positiva.

Paso 4: Escucha e impulsa

Sé flexible con la política. Deja que tu equipo explore, comparta sus opiniones y, a partir de ahí, formula políticas más detalladas basadas en tu experiencia práctica y real. Así descubrirás qué funciona de verdad y dónde residen los riesgos reales.

Reflexiones finales

El campo de la IA avanza a tanta velocidad que resulta difícil mantenerse al día incluso sin limitaciones. Si no puedes evitar lo inevitable, acéptalo. La privacidad y la seguridad de los datos son cruciales, pero prohibir la IA no garantiza su integridad. Permite que tu equipo experimente e innove dentro de los límites que consideres razonables y creen acuerdos para su uso. Dales permiso de usar herramientas que cumplan con la normativa del sector, proporciona formación y aprovéchalas.

![[Ilustración: FC]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/06100530/p-1-91516743-ai-and-cheating.webp)

![[Imagen original: master1305/Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/06073422/p-1-91516745-fractional-leadership.webp)

![[Foto: Unsplash/Nasa]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/06121050/Diseno-sin-titulo-2026-04-06T120141.845.jpg)

![[Imagen: DC Studio/Freepik]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/06130153/seguro-gastos-medicos-Fast-Company-Mexico-Freepik.jpg)

![[Imagen: Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/06114307/p-91519196-how-to-beat-decision-fatigue-e1775497427434.webp)

![[Imagen: Freepik]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/01120818/p-91505370-How-to-deal-with-a-passive-aggressive-colleague.webp)