[Fuente de la imagen: Pixabay]

[Fuente de la imagen: Pixabay]

En una reciente cumbre de inteligencia artificial (IA) en Nueva Delhi, Sam Altman advirtió que las primeras versiones de superinteligencia podrían llegar en 2028, que la IA podría ser utilizada como arma para crear nuevos patógenos y que las sociedades democráticas deben actuar antes de ser superadas por la tecnología que han construido.

Estas preocupaciones son ampliamente compartidas en toda la industria. Geoffrey Hinton, el premio Nobel conocido como “el padrino de la IA”, advirtió que la creación de seres digitales más inteligentes que nosotros mismos plantea una auténtica amenaza existencial. Mustafa Suleyman, director ejecutivo de Microsoft AI, dedicó gran parte de su libro The Coming Wave al argumento de que la fusión de la IA con la biología sintética podría poner las herramientas para diseñar una pandemia mortal al alcance de una sola persona. Estas no son advertencias sobre un futuro lejano. La semana pasada, un enfrentamiento sobre quién controla la IA y en qué términos llevó a un colapso total en la relación de la empresa con el Pentágono.

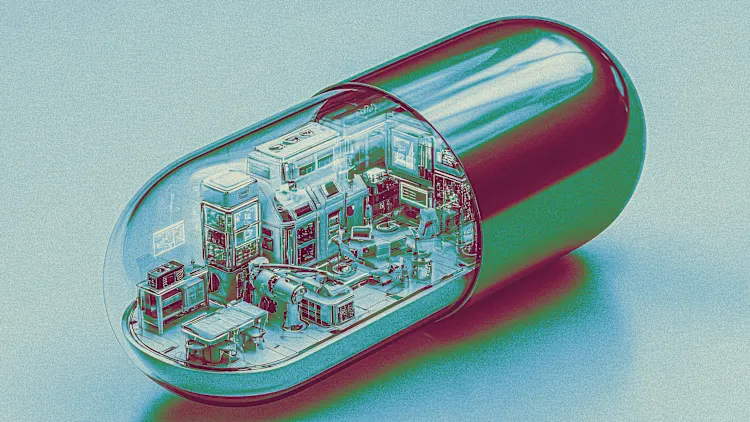

Cuando políticos y líderes empresariales intentan comprender problemas como estos, a menudo se ven tentados a recurrir a la industria farmacéutica como modelo regulatorio. El senador Richard Blumenthal, uno de los pocos legisladores que impulsa activamente una regulación significativa de la IA, ha propuesto que la forma en que el gobierno estadounidense regula la industria farmacéutica puede servir de modelo para la supervisión de la IA. La analogía tiene sentido intuitivo. El modelo farmacéutico demuestra que la concesión estricta de licencias y la supervisión de tecnologías emergentes potencialmente peligrosas pueden limitar las amenazas sin imponer restricciones indebidas a la innovación.

El atractivo instintivo de este enfoque no se limita a los legisladores. Muchas empresas aplican la misma lógica internamente, consciente o inconscientemente, gestionando el riesgo de la IA mediante revisiones por etapas, pruebas previas a la implementación y monitorización posterior al lanzamiento. En otras palabras, el modelo farmacéutico ya es el marco de gobernanza de facto para gran parte de la industria. El problema es que es el marco equivocado, y las diferencias no son solo técnicas, sino existenciales.

Tres disanalogías que importan

La regulación farmacéutica funciona porque las barreras de entrada son altas, el producto es físico y controlable, y el ciclo de desarrollo es lo suficientemente lento como para que la supervisión pueda seguir el ritmo. Ninguna de estas condiciones se cumple en el caso de la IA.

En primer lugar, las barreras de entrada son muy diferentes. Llevar un nuevo fármaco al mercado cuesta un promedio de 1,100 millones de dólares, según un estudio de 2020 publicado en el Journal of the American Medical Association. La infraestructura por sí sola (laboratorios, redes de ensayos clínicos, instalaciones de fabricación) limita la producción a un número relativamente pequeño de empresas identificables que los reguladores pueden supervisar. La IA no tiene una fricción equivalente. Se pueden crear modelos capaces por una fracción de ese coste, ajustarlos en hardware de consumo e implementarlos globalmente desde una computadora portátil. El universo de actores que un regulador necesitaría rastrear no es un puñado de empresas identificables, es potencialmente cualquiera, en cualquier lugar.

En segundo lugar, un producto farmacéutico es físico. Su fabricación requiere materias primas, equipos especializados y logística de distribución. Todo esto genera fricción que los reguladores pueden explotar imponiendo controles de supervisión. Pero el código no tiene esa fricción. Una vez publicado, los pesos de un modelo de IA pueden copiarse número por número y compartirse transfronterizamente con mucha mayor rapidez que cualquier arma física o sistema industrial. Su coste marginal de replicación es prácticamente cero. Y no se puede recuperar un software como se recupera un medicamento contaminado. Una vez que está disponible, permanece disponible.

Incluso las capacidades que se ofrecen exclusivamente mediante acceso a la nube son vulnerables a la replicación y, por lo tanto, a la violación de las barreras corporativas o regulatorias. Tan solo el mes pasado, Anthropic reveló que tres laboratorios chinos de inteligencia artificial (DeepSeek, Moonshot y MiniMax) habían utilizado 24,000 cuentas para generar más de 16 millones de intercambios con Claude, extrayendo sus capacidades más avanzadas mediante una técnica llamada destilación. Los laboratorios chinos no necesitaron infiltrarse en una cadena de suministro ni construir fábricas costosas. Solo necesitaban acceso a la API y avisos cuidadosamente diseñados, enrutados a través de redes proxy diseñadas para evadir la detección. No existe un equivalente farmacéutico a esta replicabilidad.

La última disanalogía crucial es la velocidad. El proceso de aprobación farmacéutica presupone que un producto pasará por años de pruebas controladas antes de llegar al público. Sin embargo, los modelos de IA evolucionan según los plazos del software. Las capacidades mejoran no solo mediante mejoras en el hardware, sino también mediante actualizaciones de software, nuevos métodos de entrenamiento y frecuentes lanzamientos de modelos que pueden producir avances significativos en semanas en lugar de años. Anthropic, por ejemplo, lanzó dos importantes lanzamientos de Claude en diez semanas. El ciclo de iteración es tan rápido que, para cuando cualquier proceso de aprobación similar al de la industria farmacéutica pudiera aspirar a evaluar un modelo, este ya estaría obsoleto, reemplazado por algo mucho más potente, cuyo proceso de evaluación ni siquiera habría comenzado.

Por qué “probar, implementar, monitorear” no funciona

El problema no se limita al gobierno. El mismo pensamiento, influenciado por la industria farmacéutica y que distorsiona los marcos regulatorios, se ha arraigado en las organizaciones y las expone por las mismas razones.

Los riesgos de tipo farmacéutico son familiares: un producto puede tener efectos secundarios perjudiciales, por lo que se prueba antes de su lanzamiento, se supervisa después y se retira si algo sale mal. Incluso sin un regulador externo, muchas empresas están aplicando esta lógica a la IA internamente, gestionando el riesgo mediante los métodos habituales de revisiones por etapas, pruebas previas al lanzamiento y supervisión posterior. Se siente responsable. Se siente suficiente.

Este es precisamente el peligro.

Por supuesto, las revisiones de fase y las pruebas previas a la implementación no son inútiles. Detectan errores reales, imponen disciplina y crean un registro documental que demuestra la debida diligencia ante las juntas directivas y los reguladores. Cualquier organización que las haya implementado está en mejor situación que una que no ha hecho nada. Pero estos marcos crean una falsa sensación de cobertura. El riesgo que gestionan es el riesgo para el que fueron diseñados: defectos de producto, efectos adversos, fallos en el control de calidad. El perfil de riesgo de la IA tiene una forma completamente diferente. Se define por el potencial de irreversibilidad, rápida proliferación y mal uso. No todos los resultados impulsados por la IA desencadenarán estos riesgos. Pero a diferencia de un producto defectuoso, no se puede emitir una retirada del mercado una vez que el daño ya está hecho.

Esta combinación de amenazas potenciales implica que las herramientas habituales para la gestión del riesgo simplemente no son adecuadas, y las organizaciones que creen que sí lo son están aceptando exposiciones que no han mapeado. Precisamente para afrontar estos desafíos, desarrollamos los marcos OPEN y CARE para la gestión de la innovación y el riesgo de la IA. El marco CARE, en particular, proporciona una metodología estructurada para gestionar el riesgo de la IA y constituye la base de las recomendaciones que se presentan a continuación.

Desarrollar una gobernanza para el riesgo de la IA

El marco CARE funciona en cuatro etapas: Catastrofizar, identificando qué podría salir mal; Evaluar, priorizando esos riesgos; Regular, implementando controles; y Salir, planificando para cuando esos controles fallen. Aplicado a la exposición de su organización a la IA, el marco propone cinco acciones inmediatas.

1. Saca a la luz su exposición a la IA en la sombra. Pregunta a tus subordinados directos: ¿qué herramientas de IA utiliza que no fueron proporcionadas por la empresa? Las respuestas te indicarán la diferencia entre la IA que tu organización utiliza oficialmente y la IA en la que realmente confía tu personal.

2. Mapea tus puntos de irreversibilidad y tus alternativas. Identifica los procesos que dependen de la IA donde un fallo sería irreversible o altamente perjudicial, como las comunicaciones automatizadas con los clientes, el código asistido por IA que se envía a producción y los filtros de selección algorítmicos. Pregúntate si tus medidas de seguridad actuales asumen que puede detectar y corregir errores antes de que se expongan al mundo exterior. Si es así, rediseñalas y crea procedimientos de respaldo explícitos para cuando fallen de todos modos.

3. Limita la exposición de tus datos. Cada herramienta de IA que tu organización utiliza es un flujo de datos bidireccional. Clasifica tus datos en niveles (públicos, internos, confidenciales y restringidos) e identifica qué herramientas de IA están autorizadas para cada nivel. Revisa tus contratos con proveedores para detectar cláusulas sobre datos de entrenamiento. En el momento en que los datos confidenciales ingresan a un sistema de terceros, pierdes la capacidad de recuperarlos.

4. Equipo rojo para mal uso, no solo para mal funcionamiento. El equipo rojo para mal funcionamiento pregunta “¿Qué pasa si esto se rompe?”. El equipo rojo para mal uso pregunta “¿Qué pasa si esto funciona exactamente como está previsto y alguien lo usa para el propósito equivocado?”. Como enfatiza la fase de Catastrofización del marco CARE, se necesitan ambos.

5. Asignar una responsabilidad ejecutiva clara. Nada de lo anterior importa si la responsabilidad está repartida entre los comités. Designar a un único ejecutivo responsable del riesgo de IA, de la misma manera que el director financiero se encarga del riesgo financiero. Esa persona necesita autoridad, presupuesto y una línea directa con la junta directiva.

Lo que realmente está en juego

Durante décadas, la regulación al estilo farmacéutico ha sido una de las apuestas más exitosas en el sector: un marco que protege al público sin estrangular a la industria. Sin embargo, este modelo es insuficiente para la IA.

A nivel gubernamental, personas serias buscan soluciones serias. El llamado de Sam Altman en la cumbre de Nueva Delhi a favor de un organismo regulador internacional inspirado en el Organismo Internacional de Energía Atómica refleja una visión más clara de qué tipo de tecnología se trata: una que exige marcos de supervisión acordes con su perfil de riesgo real, no modelos tomados de industrias que no comparten sus características.

Los líderes empresariales deberían seguir el mismo camino. El problema que enfrentan los gobiernos a nivel internacional es el mismo que enfrentan ustedes dentro de su organización. Diseñen su gobernanza en consecuencia: para la tecnología que realmente tienen, no para la que desearían tener.

![[Imágenes: Cliparea/Adobe Stock, Brian/Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/03/13122830/p-1-91493774-employee-fear.webp)

![[Foto: bublikhaus/Freepik]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/03/12225058/turismo-sostenible-sellos-Fast-Company-Mexico-Freepik.jpg)

![[Foto cortesía de Prada]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/03/13121327/02-91507516-prada-store-scaffolding-e1773425788180.webp)

![[Imágenes: Aleksandr Gladkiy/Adobe Stock; Senki/Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/03/13104411/p-1-91508206-does-social-networking-even-want-to-be-decentralized.webp)

![[Foto: Sasan / Middle East Images / AFP via Getty Images]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/03/13092938/p-1-91507266-us-military-leans-into-ai-for-attack-on-iran-but-the-tech-doesnt-lessen-the-need-for-human-judgment-in-war.webp)

![[Foto: LG]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/03/13084215/3-1.jpg)