[Foto: Ari He/Unsplash]

[Foto: Ari He/Unsplash]

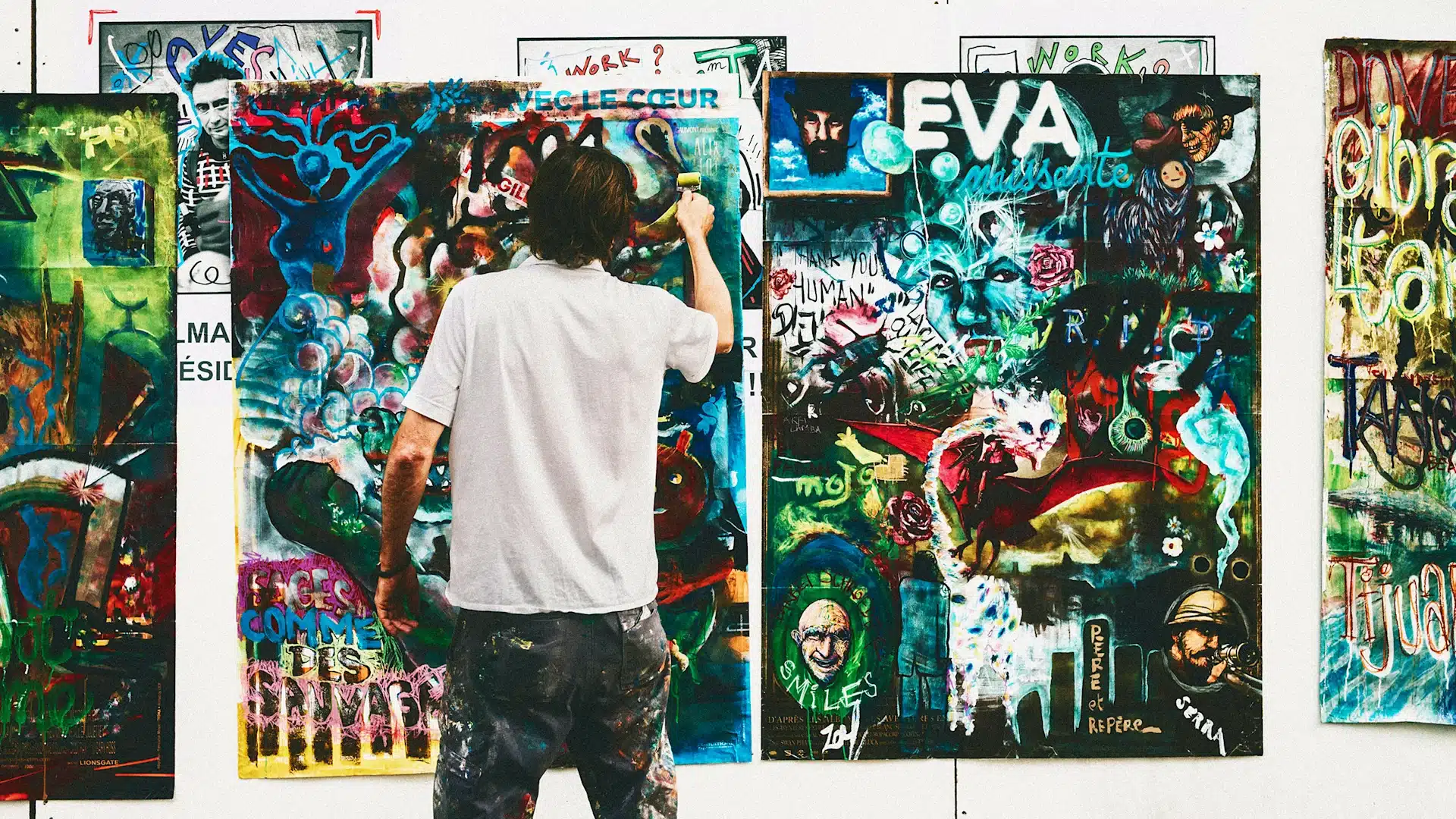

Los ojos deformes y las manos con demasiados dedos hicieron que el arte generado por IA fuera fácil de identificar. Ahora, con el avance de la tecnología, es cada vez más difícil distinguir el trabajo de artistas humanos de las creaciones hechas por máquinas.

Con el temor de algunos a la sustitución de los creativos humanos, el arte generado por IA tiene numerosos detractores. La “aversión a los algoritmos”, el prejuicio contra el trabajo creado por IA, parece estar en aumento, y solo 20% de los adultos estadounidenses cree que la IA tendrá un impacto positivo en las artes y el entretenimiento.

Los artistas se encuentran entre los principales opositores, no solo porque la IA ya está reduciendo sus ingresos a medida que las máquinas satisfacen más necesidades de imagen, sino también porque los modelos pueden haber sido entrenados con su propio trabajo.

“Este es un tema muy crítico”, afirma Philip Rieger, investigador postdoctoral de la Universidad Técnica de Darmstadt. La IA puede imitar y manipular imágenes fácilmente, violando los derechos de autor de los artistas, añade.

En respuesta, los artistas han presentado demandas alegando que las empresas de IA violaron las leyes de propiedad intelectual al entrenar con obras protegidas por derechos de autor. Otros recurren a herramientas digitales para proteger su arte. Sin embargo, los expertos afirman que el trabajo de los artistas sigue siendo vulnerable, más de lo que imaginan.

¿Cómo viola la IA los derechos de autor de los artistas?

Generadores populares como Midjourney y DALL-E de OpenAI se entrenan con millones de obras de arte, desde clásicos del Renacimiento hasta piezas digitales modernas. Esta enorme base de datos les permite imitar estilos humanos con una precisión asombrosa, lo que dificulta más que nunca distinguir la diferencia. Una encuesta de la Universidad de Yale de 2023 reveló que los estudiantes universitarios podían identificar si una obra de arte había sido creada por IA solo 54% de las veces.

Estos modelos se basan en arte protegido por derechos de autor bajo el lema de “uso legítimo”, que permite el uso de obras protegidas por derechos de autor sin el permiso del propietario en determinadas circunstancias; por ejemplo, si la obra se utiliza con fines no comerciales o si el uso no afecta el valor de la obra original.

Pero los expertos afirman que esta afirmación no se sostiene.

“Estos modelos se están entrenando con el trabajo de todos sin su autorización”, afirma Kevin Madigan, vicepresidente sénior de políticas y asuntos gubernamentales de Copyright Alliance, un grupo de defensa de los titulares de derechos de autor. “Tienen la capacidad de suplantar la necesidad de obras creadas por humanos en el mercado, lo cual es una de las razones por las que argumentamos que no debería considerarse uso legítimo usar esas cosas”.

Algunas empresas, como OpenAI, argumentan que los artistas pueden optar por no usar conjuntos de datos. Los defensores argumentan que eso carece de sentido si el entrenamiento ya se ha realizado. “Los derechos de autor son un régimen de aceptación voluntaria”, afirma Madigan. “Es como volver a meter la pasta de dientes en el tubo”.

Los debates sobre cómo la IA debería utilizar las obras protegidas por derechos de autor siguen debatiéndose en tribunales de todo el país y del mundo, pero se ha hecho poco para resolver el debate para los artistas, que hasta la fecha han tenido pocos éxitos legales.

¿Qué herramientas utilizan los artistas para proteger su obra de la IA?

Dado que eliminar obras de arte de los conjuntos de entrenamiento es casi imposible, algunos artistas intentan impedir que la IA acceda a ellas.

Las herramientas digitales, como las desarrolladas por el Glaze Project de la Universidad de Chicago, funcionan para “envenenar” las imágenes modificando los pixeles que componen las obras de arte digitales de una forma imperceptible para los humanos, pero suficiente para confundir a los modelos de IA.

“Es bastante interesante observarlo”, afirma Hanna Foerster, estudiante de doctorado en informática de la Universidad de Cambridge, quien ha estudiado la seguridad de estos modelos. “Se pueden optimizar estos pixeles dentro de una imagen aunque parezcan casi iguales al ojo humano”.

Una de sus herramientas, Nightshade, funciona haciendo que los modelos de IA vean imágenes diferentes a las que el artista representó originalmente: un bolso donde antes había una vaca, por ejemplo. Glaze, otra de sus herramientas, altera el estilo, haciendo que el modelo vea una pintura al estilo de Jackson Pollock donde el artista había creado un retrato al carboncillo.

Estos venenos buscan proteger el trabajo de los artistas una vez que ya se ha incluido en un conjunto de datos de entrenamiento. Otros, como robots.txt, funcionan para evitar que el trabajo termine en un conjunto de datos. El archivo .txt indica a los bots automatizados que rastrean sitios web en busca de contenido donde no se les permite acceder.

¿Por qué estas herramientas anti-IA no son suficientes?

Si bien existen varias maneras de evitar que los modelos de IA se entrenen con obras de arte, cada una conlleva desventajas y vulnerabilidades, según los expertos. Robots.txt, por ejemplo, puede bloquear a los bots que rastrean la web para crear conjuntos de entrenamiento, pero también bloquea los motores de búsqueda, lo que perjudica la visibilidad de los artistas.

“Esto presenta varios problemas”, afirma Madigan. No es práctico decir: ‘No publiques tu trabajo en línea’, porque eso es básicamente el sustento de la gente: tener presencia en línea.

Los “venenos” a nivel de pixel que distorsionan las imágenes para confundir a los sistemas de IA también tienen límites. LightShed, una nueva herramienta desarrollada por investigadores de seguridad de sistemas, demuestra la facilidad con la que se pueden deshacer estos venenos.

Para crear LightShed, los investigadores estudiaron cómo estos programas de protección alteran las imágenes. Encontraron patrones consistentes en la forma en que se aplicaban los venenos y entrenaron su propio modelo para reconocerlos alimentándolo con versiones limpias y envenenadas de las mismas imágenes.

“Obviamente, el aspecto varía de una imagen a otra, pero sigue siendo el mismo proceso”, afirma Foerster, quien trabajó en LightShed durante una pasantía en la Universidad Técnica de Darmstadt.

Una vez que su modelo pudo detectar el veneno con fiabilidad, simplemente lo eliminó, revelando la imagen original, sin protección, que se encontraba debajo.

Los investigadores, que presentaron su trabajo a principios de este mes en el Simposio de Seguridad USENIX, enfatizan que su objetivo no es poner en peligro a los artistas ni atacar las herramientas de protección.

“Nuestro trabajo no pretendía ser un ataque real, ni contra las herramientas ni contra los artistas”, afirma Rieger. “Solo queríamos demostrar la necesidad de herramientas de detección más robustas y que, básicamente, la gente no debería confiar ciegamente en ellas”.

LightShed solo está disponible para investigación, pero el equipo espera que genere protecciones más sólidas contra el scraping y la manipulación de la IA.

“Básicamente, estamos siendo respetuosos e informando a la gente, ya que los delincuentes que no son tan respetuosos como nosotros no les informarían”, afirma Rieger, señalando que el equipo alertó a los creadores de envenenamientos sobre las vulnerabilidades encontradas. También esperan que la noticia de sus hallazgos llegue a los artistas, quienes podrían reconsiderar cómo protegen su trabajo.

El futuro de las protecciones anti-IA

Los investigadores afirman que crear una defensa infalible contra los modelos de IA puede ser casi imposible, especialmente a medida que los sistemas de generación de imágenes se vuelven más avanzados. Para bloquear herramientas como LightShed, los envenenamientos de imágenes tendrían que ser mucho más aleatorios, pero eso correría el riesgo de hacer que la imagen fuera irreconocible para los humanos.

“Hemos pensado en cómo construir un tipo de perturbación mucho más robusta que las existentes, pero no creo que podamos garantizar en absoluto que no se vulneren de otra manera”, afirma Foerster.

Otros enfoques, como las marcas de agua criptográficas, podrían ayudar a los artistas a detectar cuándo su trabajo se ha utilizado en contenido generado por IA. Pero “es sin duda un problema muy complejo”, añade Foerster.

Más allá de las soluciones técnicas, algunos expertos argumentan que la verdadera solución reside en la regulación. Madigan afirma que proteger a los artistas requerirá legislación y acciones legales para obligar a las empresas de IA a ser transparentes sobre sus prácticas de formación.

En particular, Madigan tiene esperanzas en la legislación bipartidista presentada el mes pasado por los senadores Josh Hawley (republicano por Missouri) y Richard Blumenthal (demócrata por Connecticut), que responsabilizaría a las empresas tecnológicas por la formación de modelos en materiales protegidos por derechos de autor.

“Las empresas de IA están robando a ciegas al pueblo estadounidense y dejando a los artistas, escritores y otros creadores sin ningún recurso”, declaró Hawley. Es hora de que el Congreso les dé a los trabajadores estadounidenses la oportunidad de defender sus datos personales y sus obras creativas.

De aprobarse, el proyecto de ley podría brindar a los artistas nuevas herramientas legales para demandar a las empresas tecnológicas por violación de derechos de autor, ya sea individualmente o mediante demandas colectivas, e imponer sanciones económicas a las empresas que hagan un uso indebido de material protegido por derechos de autor.

A pesar de estos desafíos, los expertos insisten en que los artistas no deben perder la esperanza. El panorama en torno a la IA está evolucionando rápidamente, al igual que los esfuerzos para defenderse de sus riesgos.

“Mantenerse al tanto de estos problemas ayuda a empoderar a toda la comunidad artística”, afirma Madigan.

![[Fotos originales: Freepik ]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/23093215/p-91529377-how-to-find-the-right-coach.webp)

![[Imagen: Gigxels/Pixabay]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/23103841/musica-sonido.jpg)

![[Imágenes: cortesía Crocs]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/23111839/Dr-Simi-Crocs-Fast-Company-Mexico-RRSS.jpg)

![[Imágenes: American Eagle; Freepik]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/22162958/Jorge-Campos-American-Eagle-Fast-Company-Mexico-RRSS.jpg)

![El futuro CEO de Apple, John Ternus, y el futuro presidente ejecutivo, Tim Cook, estrechan lazos en Apple Park. [Foto: Apple]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/22101342/p-1-91529801-tim-cook-john-ternus-analysis.webp)

![[Foto: Getty Images]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/21093047/FCEB-templates-1-36.webp)

![[Fotos: Justin Sullivan/Getty Images; Norbert Braun/Unsplash;

Dithira Hettiarachchi/Unsplash]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/21134917/Tim-Cook-Apple-Fast-Company-Mexico-Cortesia.webp)