[Imagen impulsada por IA]

[Imagen impulsada por IA]

Una de las cosas que más disfruté de crecer en el siglo pasado fue lo efímero de la infancia y la belleza de los recuerdos compartidos con amigos, familia y las personas que íbamos conociendo en el camino. Si había fotos, casi siempre eran físicas, a menos que tuvieras a algún amigo o familiar con demasiado tiempo libre que decidiera escanearlo todo y subirlo a internet.

Puedo imaginar a algunos de mis lectores más jóvenes preguntando: “¿Para qué alguien querría una foto física? ¿O qué, los celulares de antes eran tan grandes porque venían con impresora incluida?” No. Claro que no. Visto desde hoy, no sorprende que a las generaciones más jóvenes todo eso les parezca innecesario.

La memoria ya no nos necesita

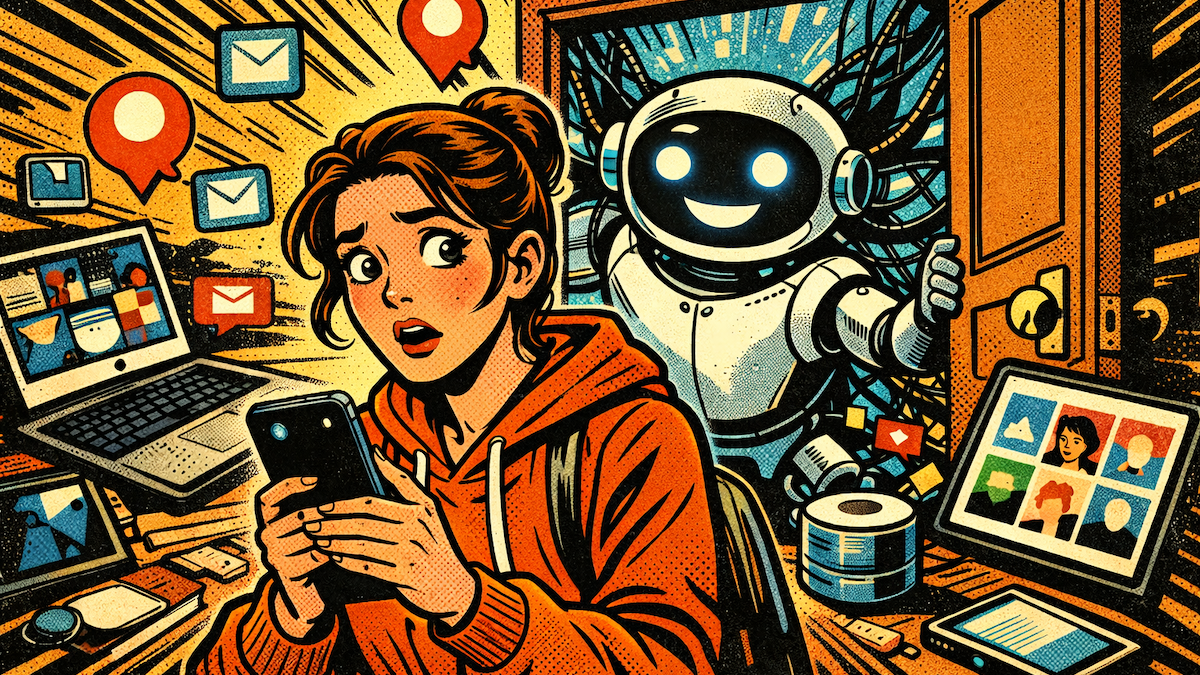

Hoy, desde niños hasta adultos, ya no dependemos de fotos físicas ni de la memoria compartida para recordar nuestra vida. Todo vive en el teléfono: mensajes, llamadas, correos, búsquedas, fotos y hasta los lugares que visitamos. Nuestra historia cotidiana está ahí, organizada, registrada y siempre disponible. Y esa disponibilidad permanente tiene un reverso del que casi no hablamos.

Nuestros teléfonos son, literalmente, la definición de spyware si caen en las manos equivocadas. Hemos priorizado tanto la conveniencia que, a medida que la tecnología se mete en más aspectos de nuestra vida, apenas lo notamos. Y sí, las comodidades que nos da son increíbles. Pero valdría la pena preguntarnos: ¿cuál es el costo de esa comodidad a largo plazo?

Cada vez más empresas de IA están pidiendo a los usuarios que les den mayor acceso a los datos almacenados en sus teléfonos y computadoras para “servirles mejor” mientras hacen su vida cotidiana. Google, por ejemplo, acaba de anunciar una IA personal basada en Gemini, con la capacidad de revisar gran parte de lo que has compartido, guardado o usado en el ecosistema de Google a lo largo del tiempo. Dicho de otro modo, ¿qué podría salir mal?

El problema no es que la IA sepa cosas

Vale aclarar que Google no es la única empresa que hace esto, y que no necesariamente es mala idea darle acceso a tu información a una IA, siempre que existan los controles adecuados. El tema con Google es que ya sabe muchísimo sobre todos nosotros. Y hay que preguntarnos: ¿realmente queremos que todo lo que está vinculado a nosotros se utilice cada vez que interactuamos con una IA? ¿En todos los contextos? Déjame explicar por qué importa.

Es fácil subestimar lo que implica que una IA sepa tanto sobre nosotros, sobre todo porque casi nunca nos detenemos a pensar en todo lo que hay ahí afuera sobre nuestra vida. Cada año les pregunto a mis estudiantes si dejarían que sus compañeros revisaran su teléfono personal sin ningún tipo de límite. A veces alguien responde que sí. Hasta que cae en cuenta de que “sin límites” realmente significa sin límites. Entonces empiezan los peros: “Bueno, sí, pero no mis estados de cuenta; ni mis fotos; ni ese correo; ni esa carpeta…”, y la lista sigue creciendo. ¿Por qué? Porque al final del día, todos queremos algún grado de autonomía y control sobre la información que compartimos, con quién la compartimos y qué cosas preferimos mantener privadas.

En muchos casos, las formas actuales de IA están integrando (a veces automáticamente) a los usuarios, y sus datos, en sus modelos, sin que la gente sea del todo consciente de lo que está pasando, en gran medida por la conveniencia que ofrecen a cambio de este nivel de acceso. Esto puede derivar en conversaciones incómodas o resultados inesperados si no tienes cuidado. ¿Te gustaría que tus datos personales, conversaciones o búsquedas se usaran para una tarea de trabajo… o al revés? ¿Qué pasaría si le prestas la IA de tu dispositivo a un colega o conocido para que te ayude con algo y el sistema saca a la luz información sensible a la que tenía acceso, pero que tú no querías compartir? Estas son solo algunas de las preguntas que deberían hacerse todos los que usan IA, o servicios que aplican IA sobre los datos que les hemos dado. No se trata de entrar en pánico ni de rechazar la IA, sino de usarla con un poco más de intención.

Entonces, ¿qué hacer si no quieres que esto te tome por sorpresa? Aquí van tres pasos para hacer una revisión rápida de higiene digital ante la IA, tanto para tus cuentas personales como profesionales:

- Asegúrate de que tus cuentas personales y laborales estén completamente separadas en todos los frentes. Nada de compartir información, carpetas o accesos.

- Elimina todo aquello que no quieras que una IA analice: correos, fotos, documentos, historial de búsquedas, etcétera.

- Entiende cómo las plataformas que usas están aplicando IA sobre tus datos y revísalo al menos cada pocos meses. Que no lo estén haciendo hoy no quiere decir que no lo hagan mañana. Si quieres darte de baja, hazlo (y asegúrate de que tus datos hayan sido eliminados). De lo contrario, confirma al menos que los pasos uno y dos estén bien cubiertos.

Recuerda que la clave para no llevarte sorpresas es estar preparado. Y eso significa tomar acciones proactivas para que lo que quieres que ocurra sea, al menos, más probable. Porque hoy la IA se ha convertido en ese familiar con demasiado tiempo libre que escanea y comparte todo. La diferencia es que ahora depende de nosotros decidir qué correos, fotos o documentos no vale la pena dejar en manos de la tía-tío IA.

![[Screenshots: @fit_aitana]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/22111718/p-1-91546466-she-has-400000-instagram-followers-and-major-brand-deals-shes-also-ai.webp)

![[Foto: vbstandret/Freepik]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/21211530/Agricultura-precision-Fast-Company-Mexico-Freepik.jpg)

![[Foto: Jessica Christian/San Francisco Chronicle via Getty Images]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/21201543/SpaceX-Twitter-Fast-Company-Mexico-COrtesia.webp)

![[Imagen: Unplash]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/20115444/youtube-politica-hombres-mujeres.jpg)

![[Ilustración: elenabsl/Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/20082348/LinkedIn-post-IA-Fast-Company-Mexico-Cortesia.webp)