[Images: Adobe]

[Images: Adobe]

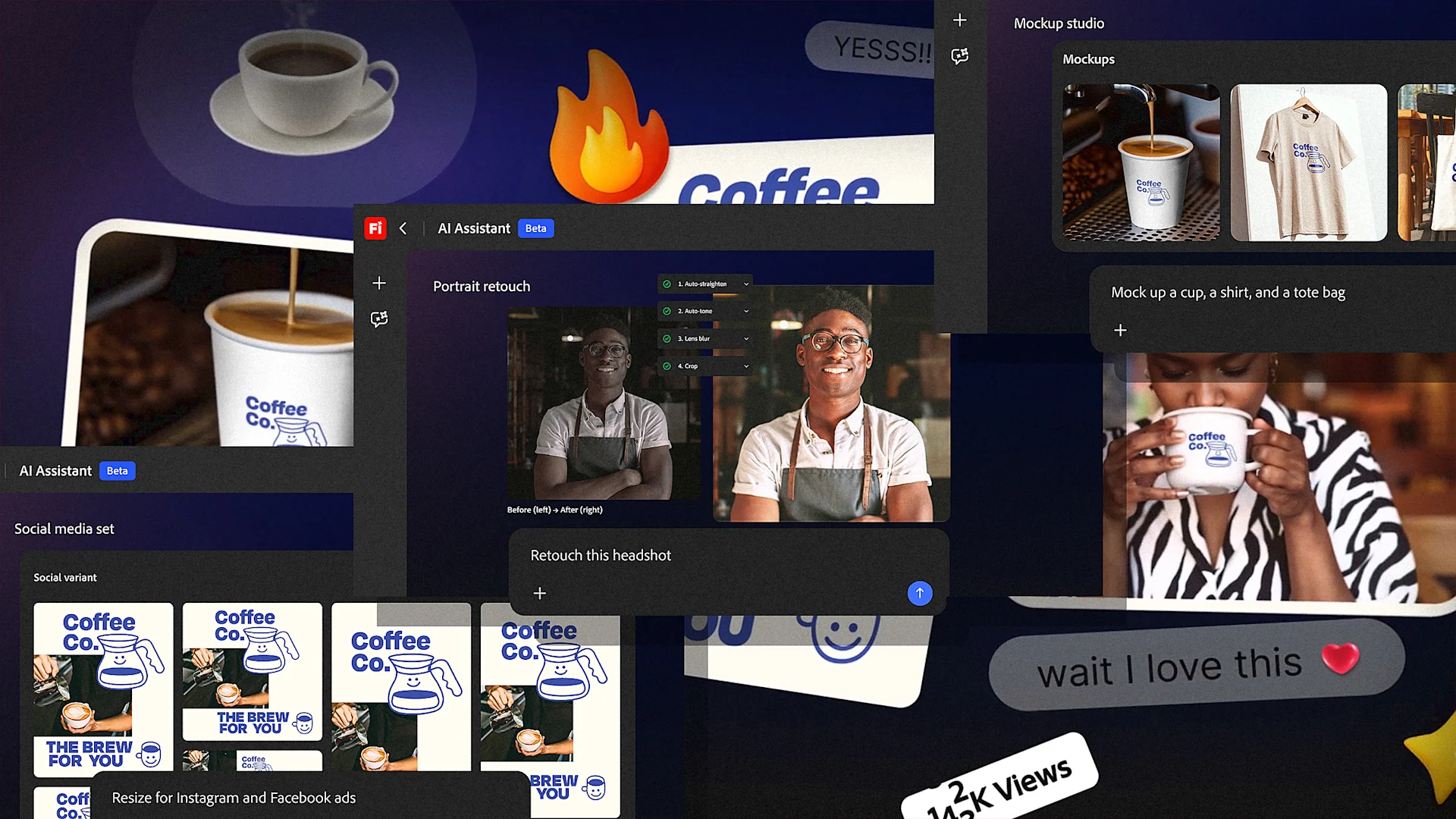

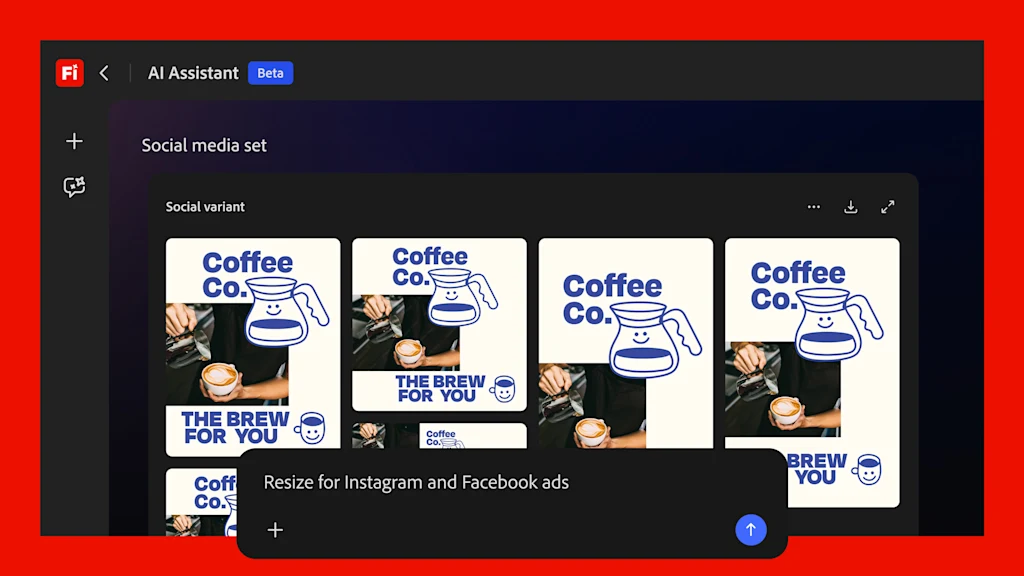

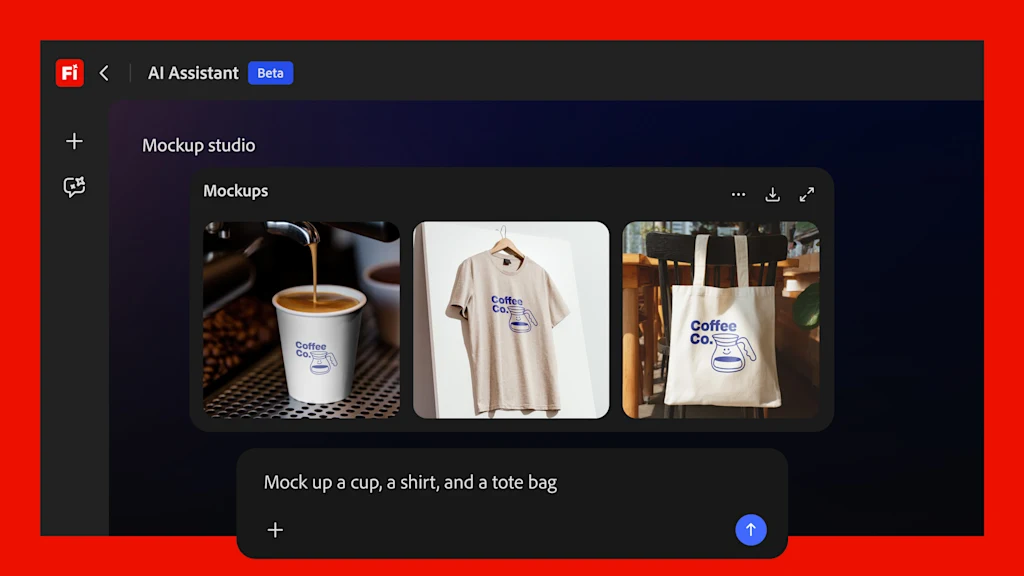

Adobe lanzará la beta pública de su Asistente de IA Firefly a finales de este mes, transformando flujos de trabajo creativos complejos en una sencilla interfaz de chat para aplicaciones como Photoshop, Premiere, Illustrator o Lightroom. Simplemente escribes lo que quieres y la IA se encarga de todo para que se haga realidad. Gracias a su interfaz multimodal, puede realizar ajustes precisos mediante paneles de control contextuales cuando sea necesario, más allá de las indicaciones de texto. Es un primer paso hacia el futuro de las aplicaciones creativas, eliminando la complejidad de las interfaces de usuario sin sacrificar el control.

Si el producto final funciona como la demo, el nuevo Asistente de IA Firefly revolucionará la forma en que las personas interactúan con el software de diseño, brindando acceso al mundo creativo profesional a cualquiera que esté dispuesto a pagar, escribir con claridad y usar controles deslizantes contextuales para ajustar con precisión aspectos de sus creaciones cuando sea necesario. En lugar de obligar a los principiantes a memorizar un laberinto de menús, paletas anidadas y ventanas emergentes, el asistente les permite lograr resultados complejos con solo preguntar.

Al mismo tiempo, el nuevo asistente es el primer paso hacia un nuevo tipo de automatización para profesionales. Ofrece a los veteranos una vía rápida para evitar las tareas tediosas que ya conocen. “Cubrimos todo el espectro: desde quienes se inician en nuestra franquicia y desconocen todo el potencial de Photoshop, pero desean lograr ediciones increíbles, pueden acceder a él simplemente hablando con el asistente”, me comentó Alexandru Costin, vicepresidente de IA e innovación de Adobe, en una entrevista. “Por otro lado, los profesionales creativos que dominan nuestras herramientas pueden tomar esos recursos y seguir editándolos con ellas”.

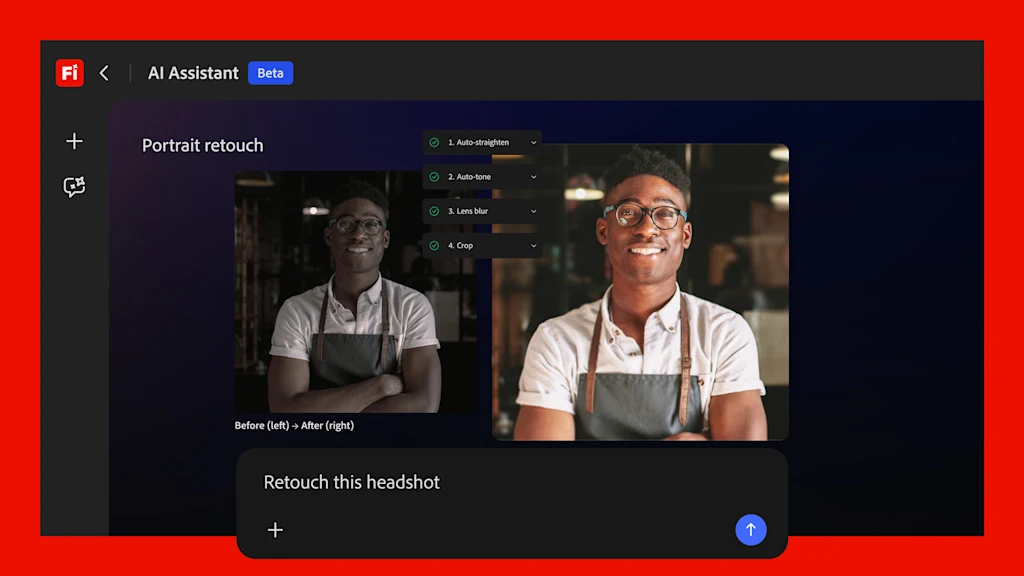

Esta herramienta surgió del Proyecto Moonlight, que Adobe presentó en la conferencia MAX del año pasado y probó en una beta privada. La idea principal provino directamente de profesionales que buscaban una actualización moderna de las Photoshop Actions, una función con décadas de antigüedad que permite a los usuarios grabar y reproducir clics del ratón.

Actions solo funcionan para tareas fijas y repetibles, como ajustar el tono y la saturación de miles de imágenes con valores fijos. Pero los usuarios querían un agente de automatización más inteligente, capaz de adaptarse a lo que ve en cada imagen, video o ilustración. Adobe decidió crear algo que va más allá de la edición básica, modificando elementos multimedia según el contexto y el contenido de la imagen o el video, e incluso creando nuevas imágenes, maquetas y versiones finales para la creación artística.

Las nuevas e inteligentes ‘Acciones de Photoshop’

“En Adobe MAX, de hecho, me reuní con un gran grupo de profesionales para preguntarles sobre IA agéntica”, me cuenta Costin, utilizando el término del sector para referirse a una IA que ejecuta activamente tareas de varios pasos en diferentes programas en nombre del usuario. “Dijeron: ‘Miren, me encantaría que me dieran un botón como el de Photoshop Actions, donde pueda grabar en un agente lo que estoy haciendo y que luego el agente pueda reproducirlo para mí, de modo que pueda decidir… que esta automatización haga las cosas a mi manera’”.

Si bien el nuevo Asistente de IA Firefly aún tiene dos limitaciones que no lo convierten en un reemplazo directo de Actions (más sobre esto más adelante), sin duda tiene el potencial de ahorrar muchísimo tiempo a cualquier profesional dispuesto a trabajar con un equipo de bots de IA.

Para hacer posible este tipo de automatización, Adobe creó lo que llama Habilidades Creativas. La IA aprende con el tiempo cómo le gusta trabajar a un creador específico, identificando sus herramientas favoritas y su estilo visual, y puede aplicar ese conocimiento para gestionar sus archivos. “Puedes describir tu gusto o enfoque particular como profesional creativo y luego poder ‘reproducirlo’ usando el sistema de IA Firefly, de modo que ahorras tiempo y puedes automatizar parte de tu trabajo para tener más tiempo para la creatividad”, dice Costin.

La versión beta actual ofrece un conjunto estándar de habilidades predeterminadas para empezar, aunque la posibilidad de editarlas y compartirlas completamente estará disponible en una versión posterior (una de las limitaciones que la diferencian de Photoshop Actions, que sí son totalmente compartibles).

En lugar de depender de plantillas rígidas, el sistema actúa como un director de arte digital autónomo. Evalúa activamente los materiales originales en tu lienzo para determinar el contexto adecuado antes de actuar, en lugar de ejecutar comandos a ciegas basados en los metadatos del archivo. El software no solo controla tu cursor, sino que también te consulta constantemente para aclarar qué quieres lograr, asegurando que sigas teniendo el control de la obra final.

Esta integración va más allá de los motores de Adobe, extendiendo la plataforma a los principales modelos de IA de terceros, incluido Claude de Anthropic. También se conecta con plataformas de revisión como Frame.io. Si un cliente deja comentarios sobre un proyecto, el agente puede procesarlos y realizar las revisiones automáticamente, seleccionando el software que mejor se adapte a la tarea.

El camino hacia las interfaces adaptativas multimodelos

El asistente también introduce Precision Flow, que reemplaza la tediosa tarea de que reemplaza la tediosa tarea de crear máscaras pixel a pixel con edición semántica. En lugar de trabajar con pixeles en bruto, la IA reconoce los objetos físicos reales dentro del encuadre: sabe que una taza de café es una taza y los granos que hay junto a ella son granos. “Precision Flow te da la oportunidad de usar IA generativa para editar un recurso no a nivel de pixel, sino a nivel semántico”, dice Costin. “Como en este caso, sabe que es una foto de café con granos de café, así que crea estos controles deslizantes semánticos dinámicos que te permiten cambiar la imagen semánticamente sin tener que volver a solicitar información”.

Esta capacidad semántica genera automáticamente nuevos paneles de control para un control preciso. En el caso de la taza de café con los granos salpicados sobre el líquido, los usuarios verán un panel con deslizadores como “Granos de café” y “Salpicadura” que pueden mover para aumentar o disminuir con precisión la cantidad de granos o salpicaduras. Este es el paso correcto para futuras aplicaciones. El lenguaje natural es un excelente punto de partida, pero su naturaleza es interpretable, lo que puede generar imprecisiones y malentendidos. No hay imprecisión en un deslizador que permite aumentar la cantidad de granos de café en la imagen de forma interactiva y en tiempo real.

Dado que el asistente está integrado directamente en Creative Cloud, las herramientas estándar como el tono y la saturación se transfieren directamente a la aplicación principal. El resultado no es un archivo de imagen inactivo; genera un documento PSD nativo, el formato de archivo estándar de Adobe que organiza las ediciones individuales en capas separadas y ajustables.

“En realidad, se trata de un control de Photoshop que, una vez realizadas estas ediciones, crea el archivo PSD y lo carga en Photoshop”, explica Costin. “Al usar una función de Photoshop, se aplica la capa de ajuste completa”.

Sin embargo, la versión beta actual aún presenta limitaciones en lo que respecta a las ediciones semánticas avanzadas. Si bien cualquier panel de control estándar, como Tono y Saturación, genera una capa editable en Photoshop, al usar Precision Flow para modificar objetos en el asistente, esos cambios específicos aún no se transfieren a Photoshop como controles deslizantes interactivos. “Todavía no hemos integrado Precision Flow en Photoshop. Es de suponer que también llegará a Photoshop, pero aún no lo hemos anunciado”, comenta Costin. “Actualmente, al realizar estas ediciones, la imagen que se transfiere a Photoshop es una imagen rasterizada”.

Esto significa que los ajustes semánticos llegan como una capa de pixeles plana e ineditable. Para los principiantes, este obstáculo técnico no supondrá un gran problema siempre que la imagen final sea buena. Para los profesionales de alto nivel a los que Adobe intenta atraer, sospecho que será más bien una molestia temporal. Sería genial tenerlo, pero puedo trabajar sin él.

Está claro que el Asistente de IA Firefly puede representar un gran avance para que el software se adapte al usuario, en lugar de al revés: que el usuario dirija a la IA para que haga lo que quiere, que la IA aprenda su estilo de trabajo y que solo muestre los controles precisos cuando sean necesarios.

![[Foto: P11irom/Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/29082124/p-1-91537318-ceo-job-risk.webp)

![[Ilustración: FC]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/29095307/p-1-91548713-the-line-chronicle.webp)

![[Foto: Radical AI]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/29081202/11-91543082-radical-ai.webp)

![[Imagen: redes sociales Timex]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/28143800/iron-maiden-timex-reloj-50-aniversario.jpg)

![[Foto: Getty Images]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/05/28142414/FCIC-and-ILF-templates-1-22.webp)