[Foto originales: Kyle Grillot/Bloomberg/Getty Images]

[Foto originales: Kyle Grillot/Bloomberg/Getty Images]

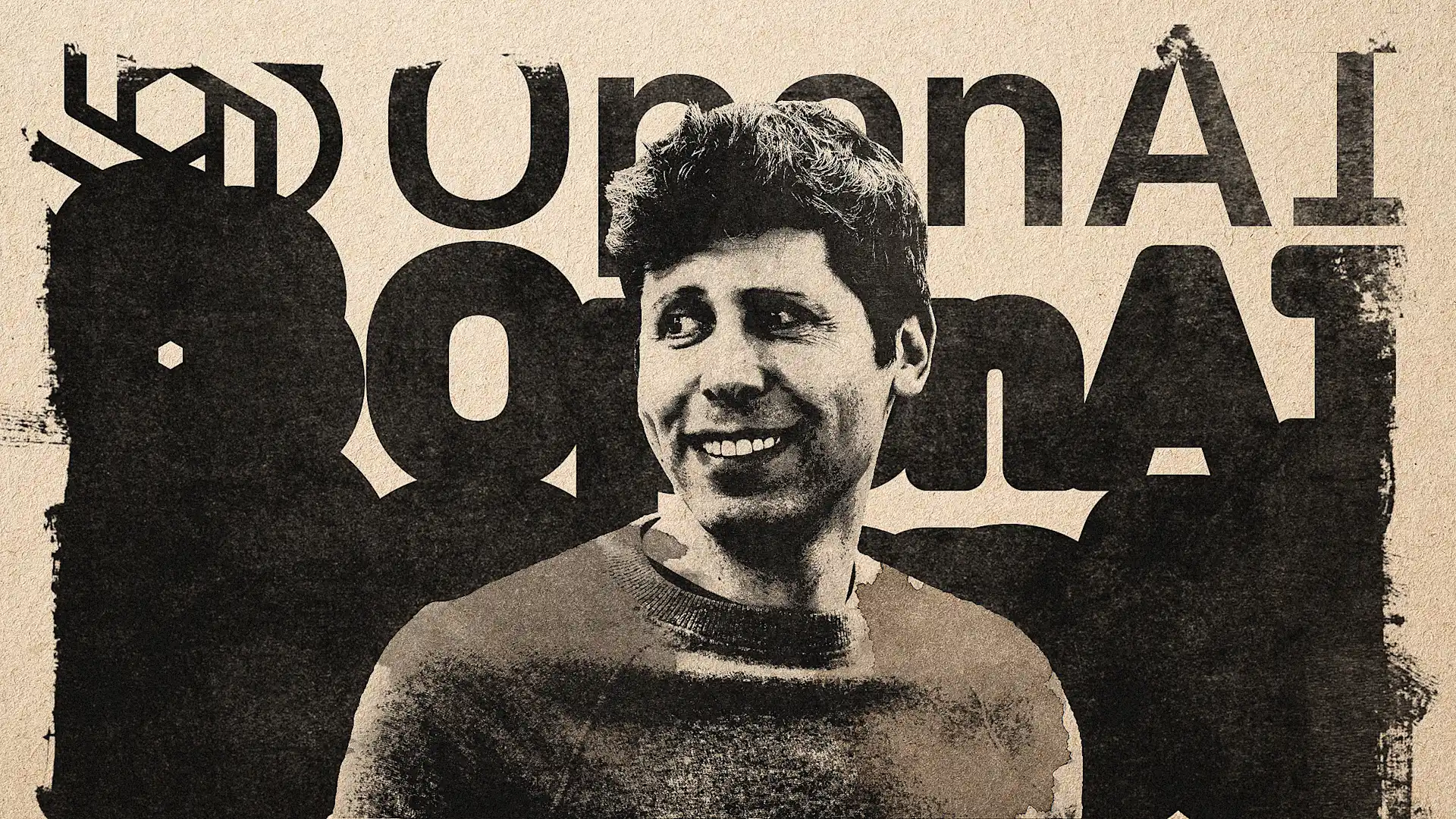

Parece un logro empresarial digno de presumir. No fue solo conseguir un cliente de alto perfil, sino hacerlo justo después de que el acuerdo de su principal rival con ese mismo cliente se desmoronara de manera brutalmente pública. Sin embargo, el acuerdo con el Pentágono de OpenAI, pionero en inteligencia artificial (IA), no terminó siendo un evento que vislumbrara la marca. Al contrario, «simplemente pareció oportunista y descuidado», según la opinión del director ejecutivo de OpenAI, Sam Altman.

Hay preocupación generalizada sobre las posibles desventajas de la IA, que van desde despidos masivos hasta robots dominantes. Es por eso que “oportunista y descuidado” son prácticamente los últimos atributos con los que OpenAI quiere que se le asocie, especialmente en el contexto de una colaboración con el Departamento de Guerra. Pero esto no es solo un problema de imagen. La reacción negativa hacia la marca ha incluido un aumento repentino de las suscripciones a Anthropic. Este es el rival al que OpenAI parecía haber superado. Pero ahora, su aplicación, Claude AI, rebasó a ChatGPT de OpenAI y se convirtió en la mejor de las listas de aplicaciones.

Parte de ese aumento se puede atribuir al comportamiento y la retórica de Anthropic. Esta se ajustan a su imagen de marca como gestor responsable de la IA, consciente de sus posibles consecuencias. Esta imagen de marca se puso a prueba recientemente, cuando Anthropic quiso añadir algunas salvedades al deseo del Pentágono de usar su tecnología para “todos los fines legales”.

Claude, de Anthropic era entonces el único agente de IA autorizado para operaciones clasificadas. Ya había sido empleado para planificar la reciente acción militar contra Venezuela (y en la preparación del ataque a Irán). Pero esta relación, evidentemente armoniosa, se vio obstaculizada por la búsqueda de medidas de seguridad que impidieran que su tecnología se utilizara para la vigilancia masiva o la letalidad autónoma. El Pentágono reaccionó, y en pocas semanas, la situación derivó en una división agria y muy pública que incluyó críticas petulantes del presidente. El Departamento de Guerra indicó que exigía mayor cumplimiento al añadir socios de IA. Además, amenazó con perjudicar a Anthropic al etiquetarla como un “riesgo para la cadena de suministro”.

Anthropic se mantuvo fiel a su imagen de empresa de IA seria y sin prejuicios. En general, Silicon Valley pareció apoyar a Anthropic. Empleados de Google, Microsoft y Amazon difundieron peticiones y cartas abiertas. En ellas instaron a los líderes corporativos a seguir el ejemplo de Anthropic y a mantenerse firmes ante los usos inaceptables de la IA por parte de los gobiernos.

Ese era el contexto cuando se anunció el acuerdo de OpenAI con el Pentágono. El Departamento de Guerra ya había estado en conversaciones con varias empresas de IA para incluirlas en casos de uso clasificados. Sin embargo, el momento del anuncio dio la impresión de que OpenAI estaba reemplazando a Anthropic. Altman prometió que la compañía tenía las mismas restricciones que Anthropic. Sin embargo, aceptó el lenguaje del Pentágono que permite el uso de la tecnología para “todos los fines legales”. OpenAI insiste en que los detalles del contrato establecen límites. Además, Altman ha afirmado que a Anthropic se le debería ofrecer el mismo acuerdo y no debería ser etiquetada como un riesgo para la seguridad.

Pero el momento oportuno y lo que algunos observadores interpretaron como una capitulación provocaron una reacción negativa. Además de las críticas en línea a OpenAI, los resultados fueron bastante evidentes en los gráficos de aplicaciones. Y es que las descargas de Anthropic y las suscripciones de pago se dispararon. El Consejo de la Industria de Tecnologías de la Información de las grandes tecnológicas, cuyos miembros incluyen a Nvidia y Apple, intervino con una carta expresando su preocupación por “la consideración del Departamento de Guerra de imponer una designación de riesgo en la cadena de suministro en respuesta a una disputa de adquisiciones”.

La firma de investigación Sensor Tower descubrió que la eliminación de ChatGPT en dispositivos móviles se aumentó 295%. Fue casi la historia de Anthropic vs. Pentagon al revés. En lugar de que una batalla por un cliente puliera una marca, un acuerdo prestigioso con un nuevo cliente pareció estallarle en la cara.

Altman ha calificado la reacción negativa como “realmente dolorosa” y resultado de una imagen desfavorable, más que de una capitulación sustancial u oportunismo. Según se informa, declaró en una reunión general que el acuerdo fue una decisión “compleja” con “consecuencias extremadamente graves para la marca” a corto plazo, pero que, en última instancia, fue la decisión correcta. Y esto podría resultar acertado a largo plazo.

Anthropic ha reanudado las conversaciones con el Pentágono para rescatar su relación. Según se informa, sus inversionistas quieren ver más diplomacia y menos egocentrismo por parte de la empresa; la marca no significará mucho sin clientes. Mientras tanto, OpenAI aún tiene mucho margen para ser oportunista, pero quizá debería esforzarse más por no parecerlo. Y es que la mejor manera de evitar consecuencias difíciles para la marca es anticiparlas.

![[Foto: Simona Murrone]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/27121722/renovacion-Coliseo-romano-Fast-Comapny-Mexico-Cortesia.webp)

![[Foto: Cortesía cerveza Victoria]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/28085114/IA-2026-04-28T225056.689.jpg)

![[Imágenes: Getty Images, Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/28132344/p-1-91533616-openai-trial-elon-musk-sam-altman.webp)

![[Imágenes: Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/27103755/medicamentos-psicodelicos-FDA-Fast-Comapny-Mexico-Cortesia.webp)

![[Imagen: Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/27140237/p-91528880-Why-designers-make-better-entrepreneurs-than-they-think-e1777320214460.webp)