[Fotos: LUDOVIC MARIN/POOL/AFP via Getty Images; Google DeepMind/Unsplash]

[Fotos: LUDOVIC MARIN/POOL/AFP via Getty Images; Google DeepMind/Unsplash]

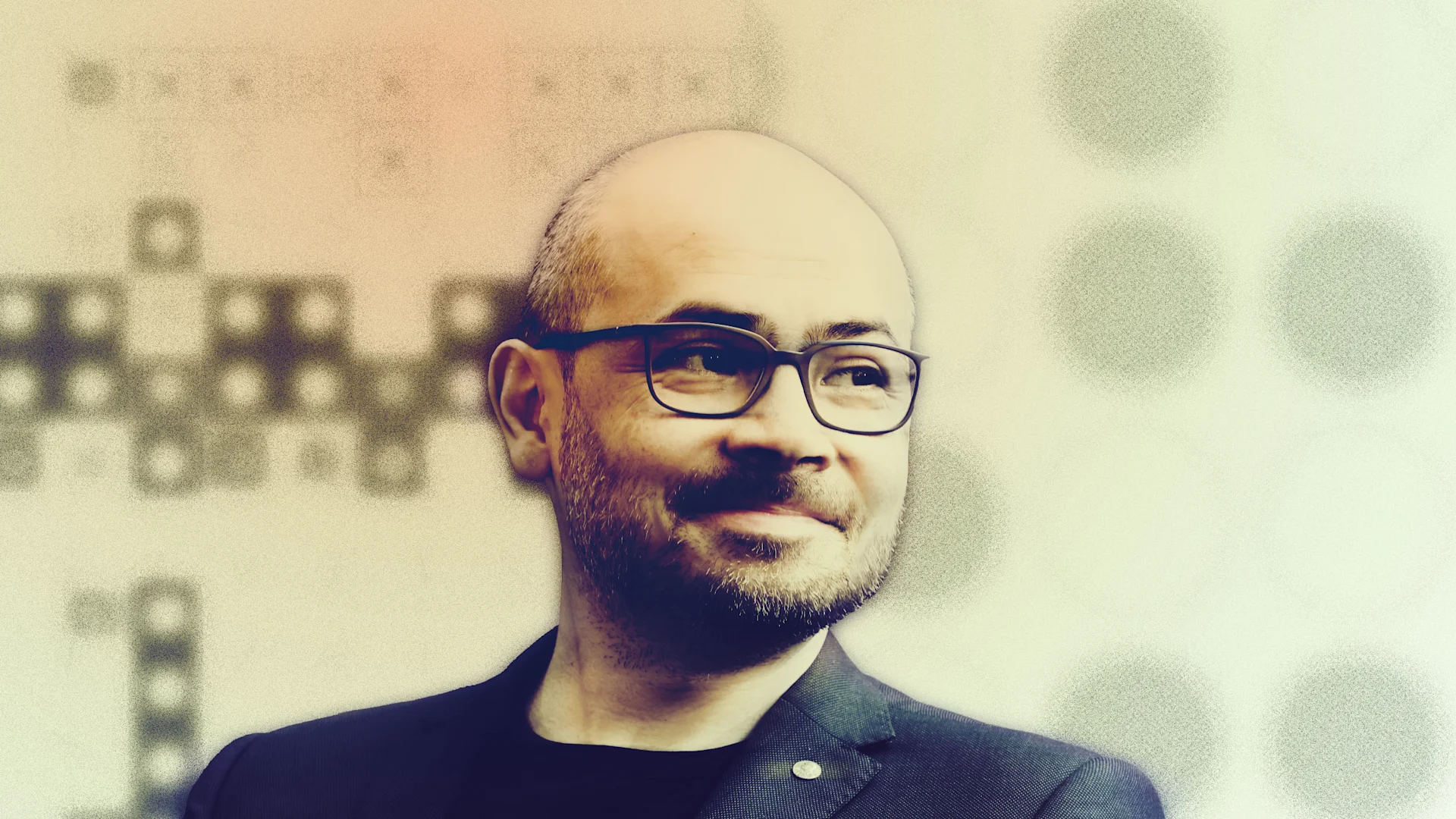

En 1988, un preadolescente londinense con afición por la programación y los videojuegos creó una versión del clásico juego de mesa Othello —también conocido como Reversi— para su computadora Amiga 500. Enseñar a un programa a jugar era un ambicioso proyecto de programación para alguien tan joven. Y con ello, Demis Hassabis logró su primer hito en el campo de la inteligencia artificial.

La aplicación que jugaba al Othello “derrotó a mi hermano pequeño, que solo tenía cinco años”, recuerda Hassabis. “Fue una revelación para mí, porque pensé: ‘¡Wow, es increíble que se pueda crear un programa inanimado y que este haga algo por ti!'”.

Aquello resultó ser una epifanía trascendental. Más de dos décadas después, esto lo llevó a cofundar DeepMind, la startup de IA que impulsó enormemente el desarrollo de esta tecnología, tanto antes como después de su adquisición por Google en 2014. En 2023, Google fusionó DeepMind con Google Brain, su otra división de IA altamente productiva, y nombró a Hassabis CEO de la operación combinada, Google DeepMind. El modelo de IA que supervisa, Gemini, es ahora la base de los productos de Google utilizados por miles de millones de personas.

Mucho antes de que los frutos del trabajo de DeepMind se extendieran por todas partes, la compañía era un laboratorio de investigación cuyo enfoque inicial era entrenar algoritmos para jugar videojuegos. Esto no solo los conectaba con la aplicación de Othello de la infancia de Hassabis. Desde los albores de la IA, los investigadores han utilizado los juegos como plataforma para el descubrimiento. Por ejemplo, en 2019 escribí sobre un programa especial de televisión de 1960 que documentaba la computadora de IBM que jugaba a las damas chinas.

Los juegos son una herramienta de investigación tan poderosa porque son “un microcosmos de algo importante en la vida real”, explica Hassabis. “Y podemos practicarlos muchas veces en un entorno serio, pero a la vez informal”.

El mes pasado se cumplió el décimo aniversario del logro culminante de esta búsqueda: un momento histórico no solo para DeepMind, sino para todo el campo de la IA. El juego de mesa chino Go, con 2500 años de antigüedad, había sido considerado, en palabras de Hassabis, “el Everest de la IA en los juegos”: tan profundo y místico en su mecánica que, durante años, las computadoras tuvieron dificultades incluso para jugarlo mal, y mucho menos para hacerlo bien. Pero del 9 al 15 de marzo de 2016, en una partida celebrada en Seúl, el software AlphaGo de DeepMind venció a Lee Sedol, campeón mundial de Go, por cuatro partidas a una.

La victoria tuvo un gran impacto, mucho más allá del público de entusiastas que se preguntaban si era posible. “Quizás, en retrospectiva, fue el comienzo de lo que hoy consideramos la era moderna de la IA”, afirma Hassabis. Sin duda, fue una prueba tangible de que la tecnología podía asombrar incluso a quienes la habían desarrollado. Pronto se sumaron otras señales, como el artículo de investigación de Google Brain de junio de 2017 sobre los “transformadores”, el ingrediente fundamental que daría lugar a la IA generativa.

AlphaGo también marcó una transición para DeepMind. Una vez que su IA dominó al Go, el mundo de los juegos ya no tenía grandes desafíos que superar, y surgieron retos más importantes. En 2018, DeepMind presentó la primera versión de AlphaFold, su algoritmo para predecir estructuras proteicas. Las implicaciones transformadoras de ese avance en áreas como el descubrimiento de fármacos y la investigación de materiales inspiraron la creación de Isomorphic Labs, una nueva startup dentro de Alphabet, la empresa matriz de Google, y llevaron a que Hassabis y el distinguido científico de DeepMind, John Jumper, compartieran el Premio Nobel de Química de 2024.

Hoy, el sitio web de Google DeepMind refleja su amplia gama de investigaciones, desde la predicción meteorológica hasta la corrección de errores en computadoras cuánticas y la comprensión de cómo se comunican los delfines. Pero Hassabis no habla de los juegos como si fueran una parte obsoleta de su pasado. De hecho, se muestra tan entusiasmado y orgulloso al hablar del largo camino que condujo a la gran victoria de AlphaGo como al hablar de las actividades actuales de Google DeepMind. Los videojuegos fueron simplemente el primer tipo de inteligencia artificial que capturó su imaginación. Lo que aprendió en el proceso sigue siendo tan relevante como siempre.

“Desde los 16 o 17 años, tuve claro que la IA era a lo que me iba a dedicar profesionalmente”, afirma. “Y, si funcionaba, sería el mayor logro de todos los tiempos”.

Del ajedrez al Pong y al Go

Cuando Hassabis se enfrentó a Othello en su Amiga, ya era un experto en juegos de mesa. A los cuatro años, empezó a jugar al ajedrez. A los ocho, había ganado lo suficiente jugando de forma competitiva como para comprarse su primera computadora. Cumplidos los 13, se convirtió en el segundo jugador mejor clasificado del mundo menor de 14 años, después de la legendaria Judit Polgár.

Hassabis reconoce que su época como prodigio del ajedrez le ayudó a perfeccionar sus habilidades para resolver problemas, visualizar y pensar con claridad bajo presión; no parece descabellado suponer que también contribuyó a su autoconfianza. “No hay muchas actividades en las que los niños puedan competir contra adultos al más alto nivel cuando tienen cinco o seis años”, afirma. (Recomienda incluir el ajedrez en los programas escolares y aún lo juega en línea en plena madrugada como “un gimnasio para la mente”).

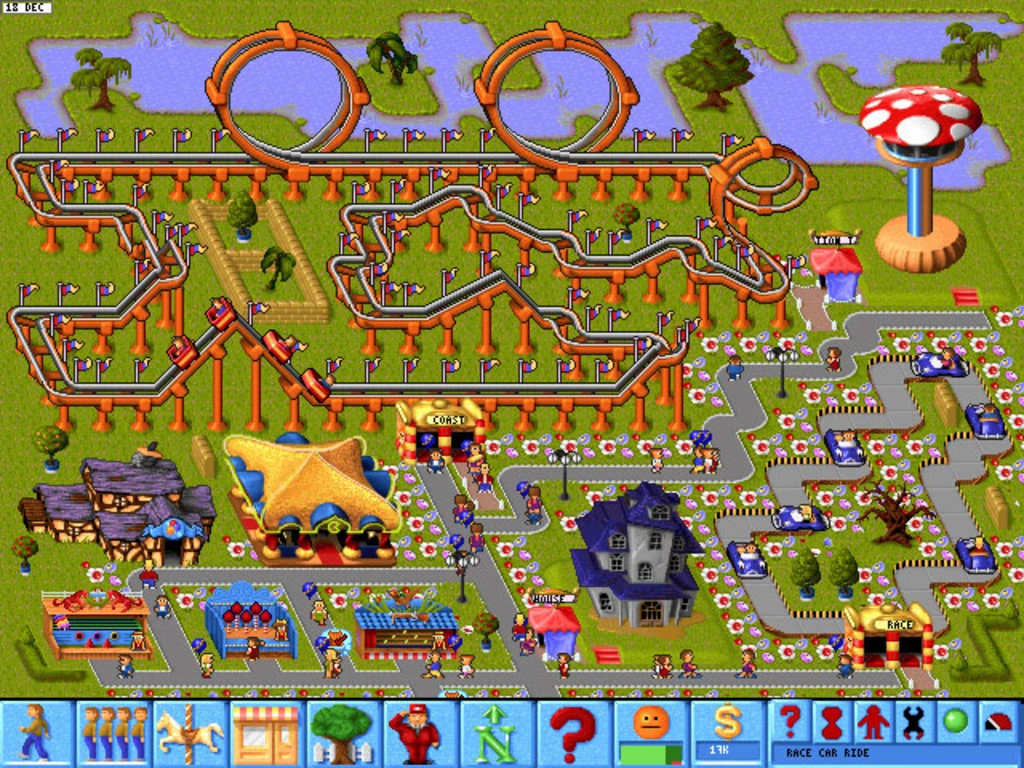

A sus 17 años, Hassabis seguía siendo un niño prodigio cuando consiguió una pasantía en el estudio de videojuegos Bullfrog tras participar en un concurso de una revista para usuarios de Amiga. Poco después, co-creó Theme Park, un simulador de parques de diversiones que vendió decenas de millones de copias.

Theme Park no solo permitía a los jugadores elegir atracciones. También fijaban precios, contrataban personal, gestionaban concesiones, vendían acciones y optimizaban el negocio para que prosperara. A diferencia de un juego de mesa o la mayoría de los videojuegos, ofrecía una experiencia de juego totalmente abierta, impulsada por un algoritmo en lugar de un conjunto fijo de reglas.

Cuando Hassabis vio que su creación se comportaba de maneras que no había programado explícitamente, quedó asombrado. “Lo fundamental era que cada vez que alguien jugaba, tenía una experiencia única, porque la IA reaccionaba a su forma de jugar”, recuerda. “Recibíamos cartas de niños. Nos enviaban capturas de pantalla de los increíbles estados finales a los que llegaban sus parques temáticos. Y no teníamos ni idea de que eso fuera posible, a pesar de que habíamos creado el juego”.

Transcurrieron 16 años entre el lanzamiento de Theme Park y la creación de DeepMind. Durante ese tiempo, Hassabis obtuvo una licenciatura en informática y un doctorado en neurociencia cognitiva, intercalados con experiencia en la industria de los videojuegos.

Cuando él y sus amigos Shane Legg y Mustafa Suleyman decidieron fundar una empresa de IA, lo hicieron con la aspiración —aún más ambiciosa en 2010 que ahora— de desarrollar algoritmos que pudieran, al menos, igualar la capacidad cognitiva humana en tareas típicas. (Legg lo denominó inteligencia artificial general, o AGI, un término que todo el sector adoptó). Sin embargo, los cofundadores comenzaron con un proyecto mucho más manejable: entrenar una IA para que destacara en los primeros videojuegos domésticos de Atari, como Pong, Breakout y Space Invaders.

No es que fuera un éxito asegurado en aquel momento. “Quizás nos adelantamos 20 años”, dice Hassabis. “Nadie lo sabía. Así que teníamos que intentarlo”.

El hecho de que los videojuegos en cuestión fueran reliquias ultraminimalistas de los años 70 no les reportó una gratificación inmediata. “Nos llevó meses ganar un solo punto en Pong, el juego más sencillo de Atari”, recuerda Hassabis. Finalmente, sin embargo, “ganamos la partida 21-0”, afirma. “Y entonces, un año más o menos, pudimos jugar todos los juegos de Atari”.

La técnica que DeepMind utilizó para dominar Pong —el aprendizaje profundo por refuerzo— tenía una amplia aplicabilidad en la IA más allá de los videojuegos. Animados por su progreso, la compañía centró su atención en el Go.

Aunque pasar directamente de algunos de los juegos más básicos del mundo a uno de una complejidad sin igual pueda parecer chocante, quizás era inevitable. Enseñar a la IA a jugar al Go al más alto nivel posible había sido un objetivo irresistiblemente audaz para los informáticos desde la década de 1970. También había sido una idea que Hassabis había tenido en mente durante 20 años, a pesar de ser solo un aficionado al juego.

Cuando era estudiante de Cambridge, había hablado de IA y Go con un compañero de clase, David Silver. En 2008, MoGo, un programa que Silver había cocreado, se convirtió en el primer software en vencer a un jugador profesional de Go, aunque con la ventaja de un hándicap. Hassabis se reencontró con su viejo amigo cuando Silver se unió a DeepMind, donde trabajó en el proyecto Atari y posteriormente lideró el desarrollo de AlphaGo.

Décadas de investigación se habían dedicado a la IA para jugar al ajedrez antes de que Deep Blue de IBM venciera al vigente campeón mundial Garry Kasparov en 1997. Pero comparado con el Go, el ajedrez parecía un juego de niños. “En el Go, hay 10 elevado a la potencia de 170 posibles posiciones en el tablero, muchas más que átomos en el universo”, afirma Hassabis. Esto descartó los métodos de fuerza bruta, como programar la IA para manejar todas las combinaciones teóricas de piezas, como había hecho IBM con Deep Blue.

DeepMind terminó entrenando una red neuronal profunda con aprendizaje por refuerzo para explorar únicamente movimientos significativos para cualquier disposición de piezas en el tablero de Go. Hassabis compara este enfoque con infundirle al algoritmo la intuición humana. Sin embargo, AlphaGo era capaz de considerar más datos que incluso el jugador humano más talentoso y disciplinado, lo que le permitía tomar decisiones que no solo parecían intuitivas, sino mágicas.

Ese punto quedó demostrado al principio de la segunda partida del encuentro entre AlphaGo y Sedol, de una forma que dejó a todos boquiabiertos y que aún resuena hoy. En el movimiento número 37 —conocida desde entonces como la “Jugada 37″— la IA eligió una jugada tan inesperada que los testigos se preguntaron si Aja Huang, el científico de DeepMind responsable del movimiento de las piezas de AlphaGo en el tablero, se había equivocado.

“Lee Sedol aprovechó ese momento para salir a fumar un cigarro al balcón”, relata Hassabis. “Regresó y vio la Jugada 37. Se le notó el cambio en la expresión facial; estaba asombrado. Y quizás también desconcertado”.

Todos los involucrados sabían que ningún maestro humano de Go habría realizado la jugada 37. Pero no quedó claro hasta mucho más adelante en la partida si había sido una jugada extraordinariamente inteligente o una jugada extraordinariamente imprudente. Finalmente, sin embargo, resultó ser esencial para vencer a Sedol: “casi como si AlphaGo hubiera colocado la pieza allí para 100 jugadas más adelante”, dice Hassabis. “No solo fue inusual, sino que fue la jugada clave para ganar la partida. Eso es lo que la convierte en una de las mejores jugadas de Go de todos los tiempos”.

Quizás se necesite ser un verdadero aficionado al Go —algo que no soy— para apreciar realmente lo que hizo especial a la jugada 37. Pero es fácil dejarse llevar por su dramatismo al ver AlphaGo, el documental de 2017 sobre la partida. Sigue siendo material para cursos, presentaciones, artículos de blog y podcasts, lo que la convierte en una firme candidata a la decisión individual más analizada tomada por la IA hasta la fecha.

Por supuesto, si la jugada 37 hubiera sido simplemente una sorprendente secuencia de juego de mesa, no sería tan fascinante. Al realizarla, AlphaGo demostró cómo la IA es capaz no solo de simular el pensamiento humano, sino de ir más allá. Alcanzar ese nivel superior de razonamiento fue la razón por la que DeepMind se dedicó al Go en primer lugar.

Investigaciones posteriores, como AlphaFold, han buscado catalizar un efecto similar. “El mundo real es mucho más difícil que un juego”, dice Hassabis, “pero se necesita ese elemento de encontrar una nueva perspectiva o una nueva estructura en los datos. Eso es lo que se busca en la ciencia”. Añade que el pensamiento similar al de la jugada 37 también se aprecia en productos actuales de Google, como la versión Deep Think de Gemini, optimizada para aplicaciones en ciencia, matemáticas e ingeniería.

En su máxima expresión, el juego humano —ya sea en una computadora, un tablero o un campo deportivo— siempre es un acto de creatividad. Hassabis no duda en calificar a la jugada 37 de creativa. Pero, por muy asombrosa que fuera, no la considera a la altura de la creatividad humana más inspirada.

“No es creatividad puramente innovadora”, subraya. “Porque eso sería como decirle al sistema de IA: ‘Crea un juego elegante que solo requiera unas horas para jugar. Aprender las reglas lleva cinco minutos, pero dominarlo requiere varias vidas. Y además, es de una belleza esotérica'”.

En otras palabras, afirma, la IA debe hacer algo más que evocar momentos como la jugada 37 para demostrar su legitimidad creativa: “Necesita inventar un juego tan profundo y hermoso como el Go; y, obviamente, con los sistemas actuales, estamos muy lejos de eso”. Esto les brinda a los investigadores de IA de Google DeepMind y otros lugares otro desafío lúdico que superar, y a los humanos una prueba reconfortante de que seguimos siendo imbatibles, por ahora, al menos en un aspecto importante.

![[Imagen: Starbucks]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/16125907/p-1-91527369-starbucks-chatgpt-experiment.webp)

![[Imagen: francescoch/Getty Images]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/16101123/p-1-91523769-tech-leader-self-perception.webp)

![[Fotos: Gabriel V. Cardenas/AFP/Getty Images, Marvin Joseph/ The Washington Post /Getty Images, Mario Tama/Getty Images, SpaceX]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/16110921/p-1-91527604-spacex-ipo.webp)

![[Imagen: Adobe Stock]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/15142911/p-1-91526714-playtomic-padel-app-dating-e1776285006181.webp)

![[Imagen: Canva]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/14094910/1-1.jpg)

![[Imagen: Freepik]](https://fc-bucket-100.s3.amazonaws.com/wp-content/uploads/2026/04/16071931/Diseno-sin-titulo-2026-04-16T071904.194.jpg)